CI/CD beschleunigen

Repository- und Artefakt-Caching

Artefakte und Container schnell und zuverlässig ausliefern – ohne die Infrastruktur unnötig zu belasten.

Varnish Enterprise lässt sich direkt in Ihre CI/CD-Toolchain integrieren und beschleunigt Build- und Deployment-Prozesse durch effizientes Caching von Abhängigkeiten. Weniger Traffic zum Origin, niedrigere Cloud-Kosten, stabilere Pipelines.

Schnellere Builds, smarteres Caching

DevOps-Beschleunigung beginnt mit der richtigen Cache-Schicht

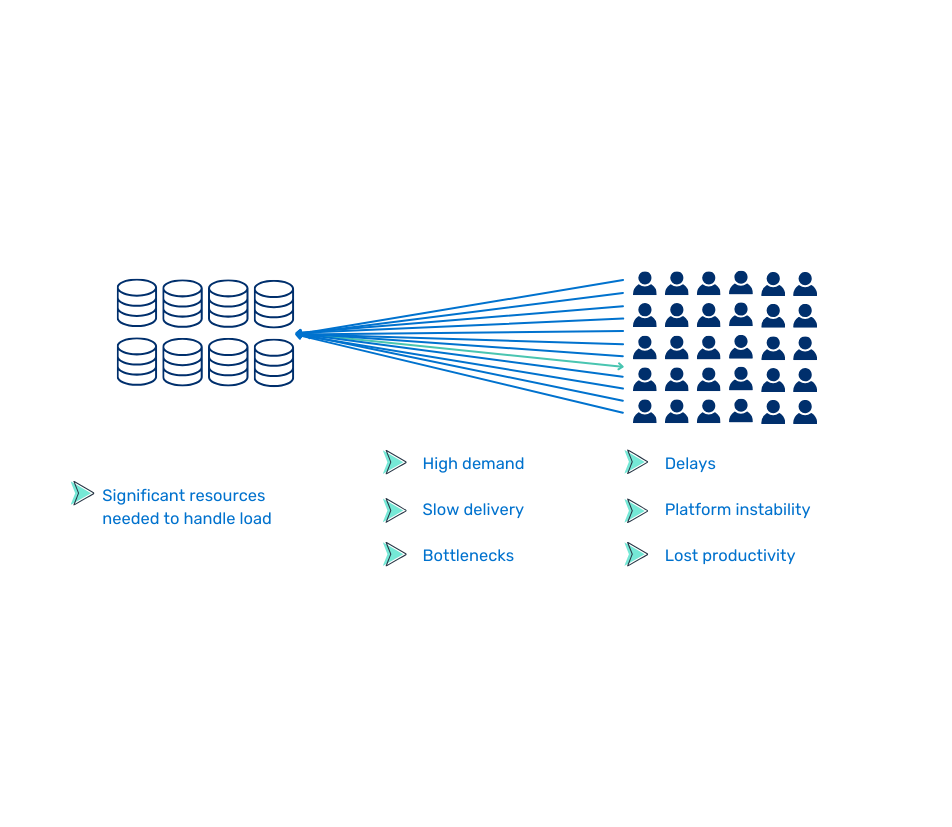

DevOps-Teams brauchen schnellen Zugriff auf gemeinsame Komponenten und Container – doch viele Pipelines bremsen aus durch:

- Wiederholte Downloads von Abhängigkeiten

- Netzwerklatenz & hohe Egress-Kosten

- Engpässe in Repositories bei CI/CD-Spitzen

- Langsamen Datenzugriff

- Skalierungsgrenzen bei steigendem Traffic

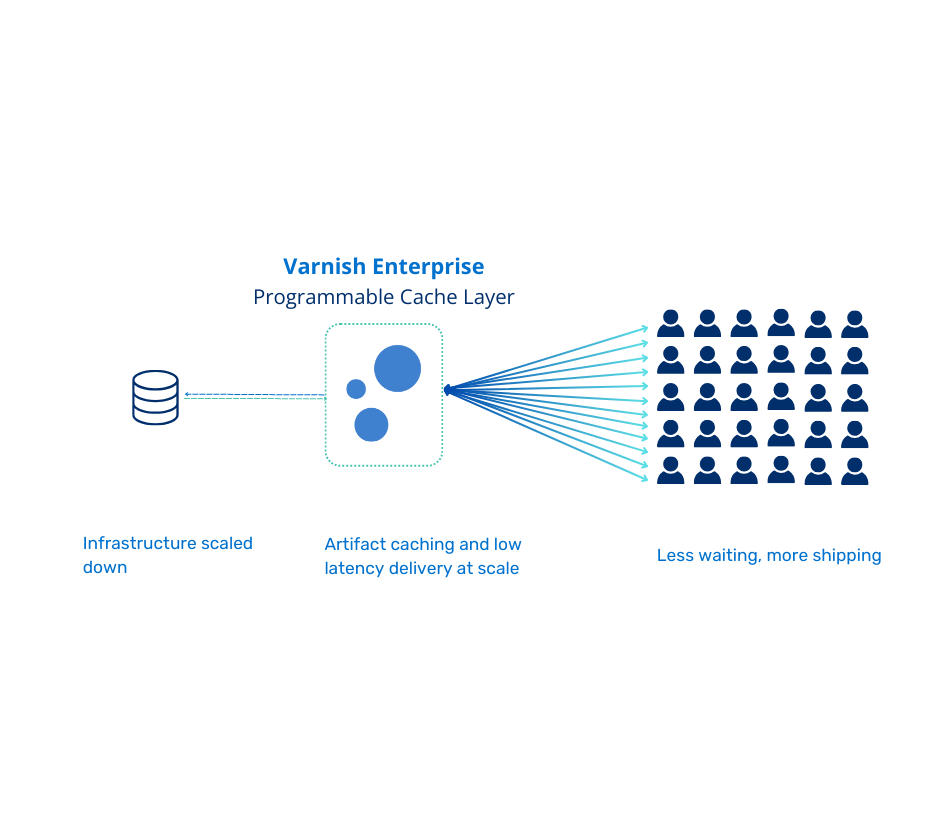

Varnish cached Artefakte und Container nahe an Ihren Teams – reduziert Latenz, entlastet Ihre Systeme und hält Ihre Build- und Deploy-Prozesse schnell und stabil.

Caching für echte DevOps-Workflows

Was Varnish Enterprise wirklich macht

Varnish Enterprise sitzt direkt im Herzen Ihrer Softwarebereitstellung – zwischen Entwicklern, CI/CD-Tools und Artefakt-Repositories. Es speichert und liefert Abhängigkeiten, Pakete, Container und mehr – schnell, skalierbar, zuverlässig.

- High-Speed-Caching für Artefakte, Container & Pakete

- Kompatibel mit JFrog Artifactory, Sonatype Nexus, Maven, Gradle, pip, npm, Docker, GitHub u. v. m.

- Flexibel einsetzbar: Cloud, On-Prem, Edge oder Hybrid

- Programmierbare Delivery-Architektur mit Security, Load Balancing & Observability an Bord

Lieferung beschleunigen. Ressourcen optimieren. Verfügbarkeit maximieren.

Varnish Enterprise ermöglicht Entwicklungsteams schnellere Releases, eine effizientere Infrastruktur und zuverlässige Skalierung – bei deutlich geringeren Kosten.

Beschleunigung

Beseitigt Engpässe bei Artefakten und Repository-Zugriffen

Effizienz

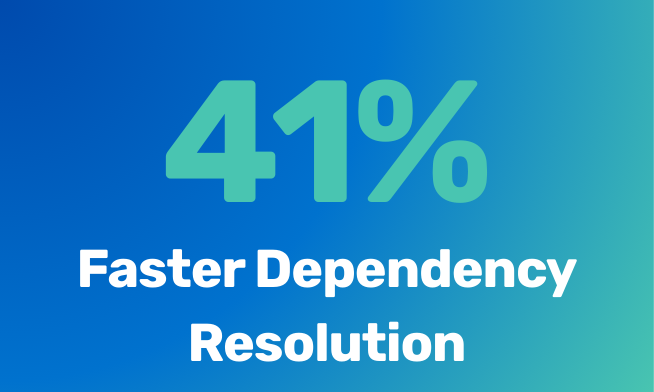

Spart Zeit in Build-Prozessen und verkürzt CI/CD-Zyklen

Optimierung

Reduziert Infrastruktur- und Traffic-Kosten durch intelligentes Caching

Resilienz

Höhere Verfügbarkeit und Lastaufnahme mit weniger Hardware

Inline bereitgestellt. Nahtlos integriert.

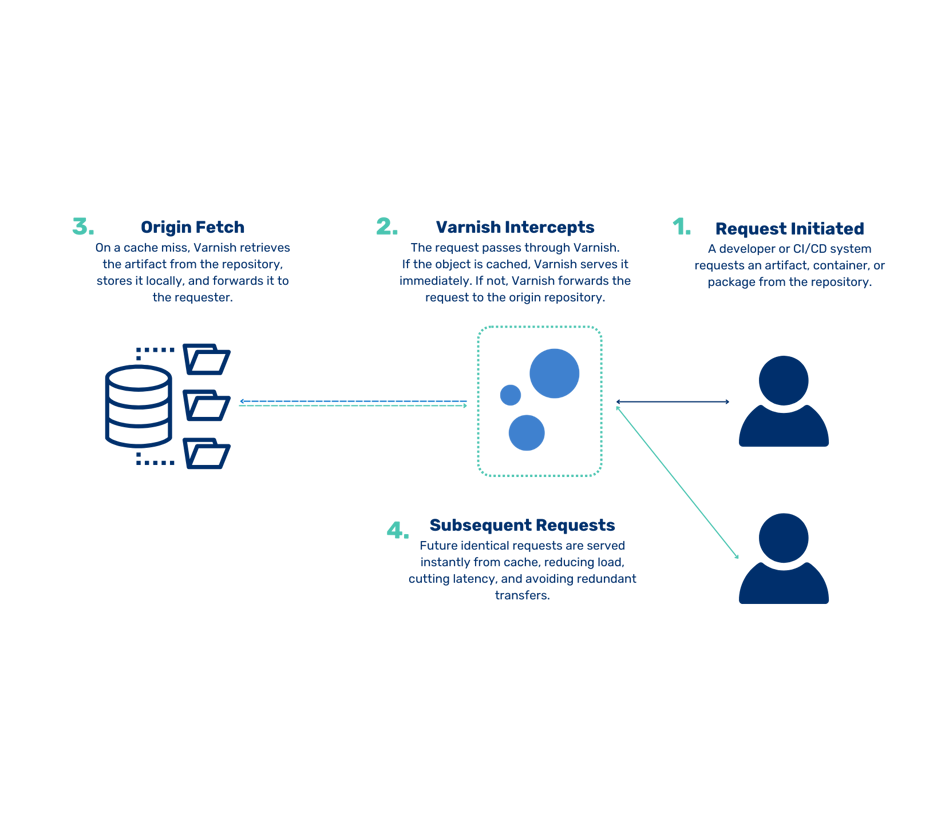

So funktioniert Varnish in Ihrer Toolchain

Varnish wird transparent zwischen Entwicklern, CI/CD-Systemen und Ihren Artefakt- oder Container-Repositories platziert. Bei einer Anfrage prüft Varnish, ob das benötigte Artefakt, Paket, die Abhängigkeit oder Container-Schicht bereits lokal im Cache liegt.

IIst das Objekt im Cache vorhanden, liefert Varnish es direkt aus dem lokalen Speicher – das reduziert die Latenz deutlich und macht Ihre Pipelines spürbar reaktionsschneller. Ist das Objekt noch nicht zwischengespeichert, wird es vom Ursprungsserver abgerufen, lokal gespeichert und steht ab dann sofort zur Verfügung.

Varnish unterstützt Sie dabei:

-

Abhängigkeitsauflösungen und Image Pulls zu beschleunigen

-

Artefakt-Server zu entlasten

-

Redundante Transfers zu vermeiden

-

Global verteilte Teams mit lokalem, latenzarmem Zugriff zu versorgen

Caching auf Enterprise-Niveau

Wichtige Funktionen für die Softwareverteilung

Varnish ist nicht nur schnell – sondern auch sicher, skalierbar und für komplexe Unternehmensumgebungen mit strengen Zugriffs- und Sicherheitsanforderungen entwickelt.

| Zugangskontrolle integriert Varnish lässt sich nahtlos in bestehende Zugriffskontrollsysteme einbinden. So werden Artefakte sicher ausgeliefert – ohne Abstriche bei Authentifizierung oder Autorisierung. |

|

| Massive Storage Engine (MSE) Leistungsstarke, plattenspeicherbasierte Caching-Architektur mit flexiblen Speicherregeln. Ideal für große Container-Images, Binärdateien und Paketdaten. |

|

| Varnish-Clustering Clusterfähige Deployments für horizontale Skalierung und hohe Verfügbarkeit. Caches lassen sich über Regionen und Rechenzentren hinweg gemeinsam nutzen. |

|

| Ende-zu-Ende TLS-Verschlüsselung Sichere Auslieferung von Artefakten und Paketen – mit vollständiger TLS-Unterstützung vom Client bis zum Origin. |

Anwendungsfall: Beschleunigte Bereitstellung über selbstgehostete und cloudbasierte Artifactory-Umgebungen hinweg

Artefakt-Repositorys wie JFrog Artifactory sind zentral für CI/CD-Prozesse. Sowohl selbstgehostete als auch cloudbasierte Deployments bringen jedoch operative Herausforderungen mit sich.

Herausforderungen bei selbstgehosteter Artifactory

- Leistungseinbußen unter hoher Last

- Skalierung erfordert zusätzliche Hardware

- Zentrales Ausfallrisiko

Herausforderungen bei cloudbasierter Artifactory

- Latenz durch regionale Verteilung

- Ansteigende Kosten durch nutzungsbasierte Abrechnung

- Eingeschränkte Kontrolle über Infrastrukturkomponenten

Varnish lässt sich nahtlos in selbstgehostete und cloudbasierte Artifactory-Setups integrieren und stellt eine konsistente, leistungsstarke Caching-Schicht bereit, die:

- Artefakte nahe an Nutzer und Pipelines cached

- Origin-Zugriffe und Cloud-Egress reduziert

- Zustellung konsistenter und Systeme ausfallsicherer macht

- In On-Premise-, Hybrid- und Multi-Cloud-Umgebungen zuverlässig funktioniert

Implementierung und Einsatz

Varnish kann auf verschiedene Arten bereitgestellt werden:

- Als lokaler Caching-Knoten in einzelnen Regionen oder Rechenzentren

- Als globaler Cluster zur Versorgung von Teams an mehreren Standorten

- Als containerisierter Edge-Service vor Tools wie Artifactory oder Nexus

Der Varnish Artifact Cache ist Teil einer programmierbaren Delivery-Schicht, die Caching, Traffic-Routing, Sicherheit und Monitoring in einer konsistenten Architektur vereint. Die Lösung integriert sich reibungslos in bestehende CI/CD-Pipelines und unterstützt Automatisierung, Skalierung und Überwachung über gängige Standardtools.

Bewährte Effizienz im großen Maßstab

Kosten senken – Leistung steigern – Infrastruktur verschlanken

Varnish Enterprise reduziert Last, Bandbreite und Komplexität in der Softwarebereitstellung – für mehr Performance und niedrigere Kosten.

Weniger Cloud-Egress

Das Caching wiederholter Anfragen senkt den ausgehenden Datenverkehr aus Cloud-Speichern und Repositories – reduziert Egress-Gebühren und entlastet das Netzwerk in CI/CD-Pipelines.

Geringere Repository-Last

Redundanter Traffic wird von Tools wie Artifactory oder Nexus abgefangen – das entlastet das Backend und verzögert teure Skalierungsmaßnahmen bei hoher Auslastung.

Schlankere Infrastruktur

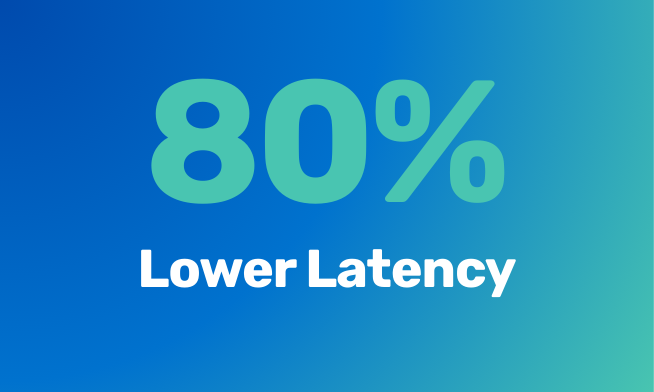

Anfragen werden näher an Nutzern und CI-Systemen bereitgestellt – das verbessert die Latenz in hybriden Umgebungen und erhöht die Systemstabilität.

Nicht alle Caches sind für DevOps gemacht

Mehr als nur integriertes Caching

Engineering-Teams verlassen sich oft auf eingebaute, Open-Source- oder Freemium-Caching-Lösungen – die aber bei wachsendem Umfang schnell an ihre Grenzen stoßen. Varnish bietet, was andere nicht leisten: konsistente Performance, volle Kontrolle über die Architektur und Stabilität unter hoher Last.

Lokale oder Remote-Build-Caches (Bazel, Gradle, Maven)

Verteilt über Teams, tool-spezifisch, schwierig bei Multi-Terabyte-Datenmengen

Eingebaute Repository-Caches (Artifactory, Nexus)

Für Speicherung optimiert, nicht für Geschwindigkeit; hohe Cloud-Egress-Kosten; begrenzte Parallelverarbeitung

Open-Source-Reverse-Proxies (Nginx, Squid)

Keine granulare Cache-Invalidierung, keine persistente Speicherung, keine native DevOps-Integration

In-Memory-Caches (Redis, Memcached)

Flüchtig und nicht persistent; nur für interne Beschleunigung geeignet – nicht für vollständiges Pipeline-Caching

Warum Varnish überzeugt

Varnish Enterprise wurde für große, artefaktlastige Umgebungen entwickelt. Für Platform Engineers und Build-Infrastruktur-Teams löst es zentrale Herausforderungen:

Persistente, kontrollierte Caching-Schicht

Varnish ist eine eigenständige Delivery-Ebene – kein Plugin, kein nachgerüsteter Proxy. Sie steuern, was gecached wird, wann es aktualisiert wird und wie es skaliert.

Zuverlässigkeit unter Last

Varnish fängt plötzliche Lastspitzen ab, ohne Artefaktserver zu überlasten – selbst wenn hunderte oder tausende Builds gleichzeitig auf dasselbe Binary zugreifen.

Flexible Architektur

Varnish läuft dort, wo es gebraucht wird: nah an Runnern, in Edge-Zonen oder direkt neben Repositories – als Container, Bare-Metal oder in der Cloud. Keine erzwungene Topologie, kein Vendor Lock-in.

Das Ergebnis: Höhere Cache-Trefferquote, weniger Zugriffe auf den Origin und eine skalierbare Infrastruktur – ohne unnötige Überprovisionierung.

Solution Brief

Die DevOps-Herausforderung

Performance, Effizienz und Kostenkontrolle im Petabyte-Maßstab

Viele Unternehmen bewegen heute jeden Monat Petabytes an Daten durch ihre Build-Pipelines. Dabei geht es längst nicht mehr nur um technische Engpässe – sondern um geschäftskritische Risiken, die Rentabilität, Agilität und Innovationsfähigkeit direkt beeinträchtigen.

Unser aktueller Solution Brief beleuchtet die zentralen Herausforderungen rund um DevOps-Produktivität – und zeigt, wie führende Unternehmen ihnen erfolgreich begegnen.

Bereit für den Einstieg?

Wir helfen Ihnen gerne bei allen Fragen zu unserer Software, zum Support, zu den Preisen und zu allen anderen Fragen zu Varnish. Wir können Ihnen helfen, die Lösung zu finden, die Ihren Bedürfnissen am besten entspricht, und auch Testversionen einrichten.

Sprechen Sie mit einem Experten

- Die Experten von Varnish stehen Ihnen zur Verfügung, um Ihre technischen Fragen zu beantworten und Ihnen dabei zu helfen, die von Ihnen benötigte Lösung zu finden.

Angebot anfordern

Fordern Sie noch heute ein Angebot an und erfahren Sie mehr über die Preise von Varnish.

Kontakt

Wir haben Büros auf der ganzen Welt, die Ihnen bei der Beantwortung Ihrer Fragen helfen können.